De juiste AI-partner demonstreert domeinexpertise in uw sector, heeft een bewezen methodologie van pilot tot productie, biedt transparante prijsstelling, behoudt uw IP-eigendom, en kan verifieerbare casestudy’s tonen met meetbare resultaten — niet alleen indrukwekkende demo’s. Met leveranciersgeleide implementaties die twee keer zo vaak slagen als interne builds, is partnerselectie de beslissing met de hoogste hefboomwerking in uw AI-investering. Dit artikel geeft u een gewogen evaluatiekader, de rode vlaggen die falen voorspellen, en de exacte vragen die u moet stellen voordat u tekent.

Waarom Partnerselectie de Beslissing met de Hoogste Hefboomwerking Is

Het verschil tussen AI-succes en -falen is niet het algoritme — het is de implementatiepartner. De juiste partner kiezen heeft meer impact dan de juiste technologie, de juiste use case, of zelfs het juiste budget kiezen.

MIT’s Project NANDA toonde aan dat leveranciersgeleide AI-implementaties slagen in 67% van de gevallen vergeleken met slechts 33% bij interne builds. Dit 2×1-succesverschil gaat niet over betere technologie bij de leverancier — het gaat over betere methodologie. Ervaren AI-partners hebben de datakwaliteitsproblemen, integratie-uitdagingen en verandermanagementweerstand tegengekomen en opgelost die eerstelijnsprojecten doen ontsporen. Ze hebben de projectgovernancestructuren gebouwd die scope creep voorkomen, de validatiekaders die modeldrift opvangen, en de implementatiepatronen die AI van pilot naar productie brengen zonder de 18 maanden vertraging die enterprise-pogingen kenmerkt.

Toch besteden de meeste bedrijven, ondanks dit bewijs, meer tijd aan het evalueren van CRM-software (€ 500/maand) dan aan het evalueren van AI-partners (€50.000–€200.000 investering). De evaluatie bestaat vaak uit het vergelijken van offerteprijzen en het bekijken van demopresentaties — geen van beide voorspelt implementatiesucces. 74% van de bedrijven worstelt om waarde te halen uit AI-investeringen, en een significant deel van dat falen vindt zijn oorsprong in de partnerselectiefase, niet in de technologieselectiefase.

Dit artikel biedt een gestructureerd, gewogen evaluatiekader dat subjectieve indrukken vervangt door datagedreven beoordeling. Gebruik het om elke AI-partner te evalueren — inclusief ons. De criteria zijn universeel, de vragen zijn specifiek, en de rode vlaggen zijn afgeleid van patronen waargenomen in honderden mislukte AI-trajecten gedocumenteerd in het sectoronderzoek.

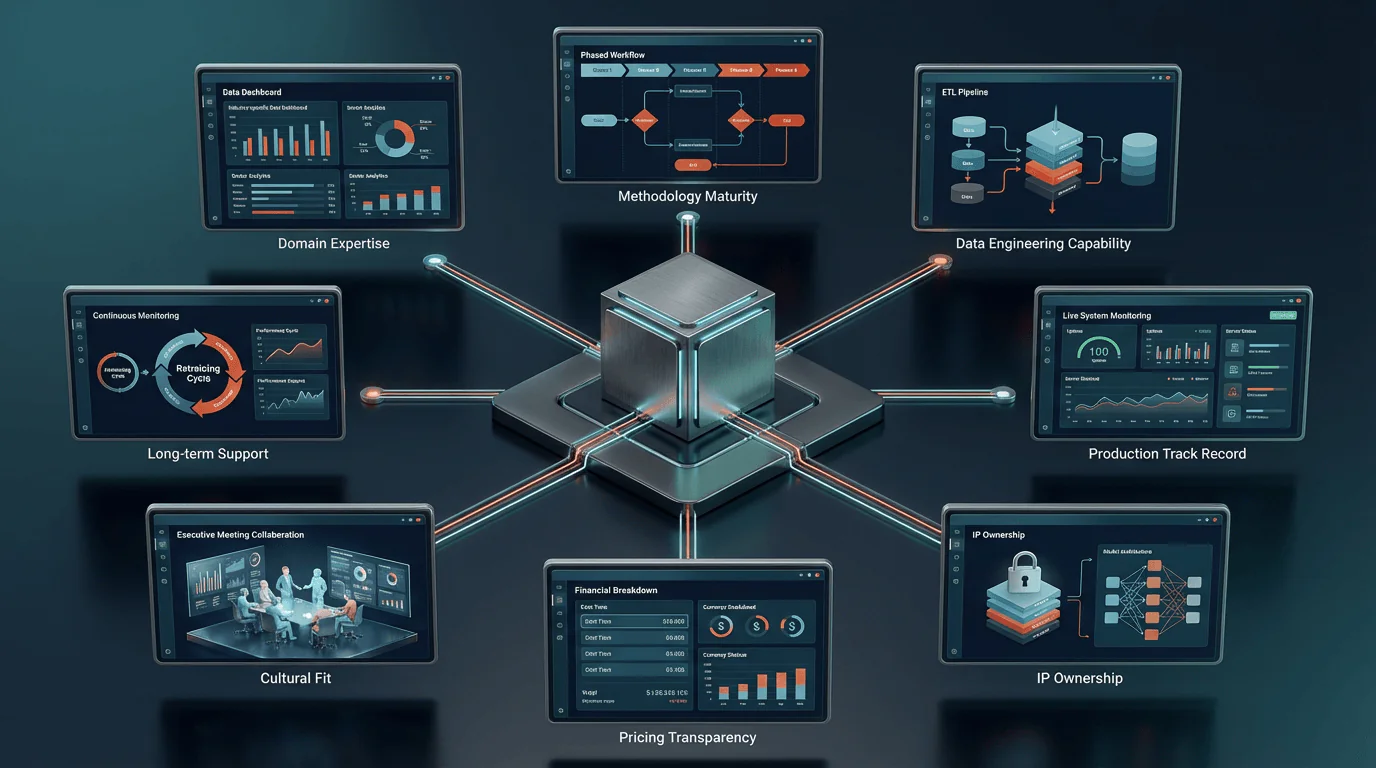

De Acht Evaluatiecriteria: Een Gewogen Scorekader

Niet alle evaluatiecriteria wegen even zwaar. Domeinexpertise en methodologievolwassenheid zijn samen goed voor 45% van de score omdat ze de sterkste voorspellers zijn van implementatiesucces. Prijstransparantie en IP-eigendom, hoewel commercieel belangrijk, zijn kwalificerende factoren in plaats van onderscheidende.

| # | Criterium | Gewicht | Wat Het Voorspelt |

|---|---|---|---|

| 1 | Domeinexpertise | 25% | Of de partner de data, regelgeving en operationele realiteit van uw sector begrijpt |

| 2 | Methodologievolwassenheid | 20% | Of de partner een herhaalbaar, fasepoort-gestuurd proces heeft van discovery tot productie |

| 3 | Data Engineering-capaciteit | 15% | Of de partner met rommelige, reële data kan omgaan — niet alleen schone datasets |

| 4 | Productie-implementatie Track Record | 10% | Of de AI-systemen van de partner daadwerkelijk in productie draaien, niet alleen in pilot |

| 5 | IP-eigendom & Datarechten | 10% | Of u eigenaar blijft van het model, de datapipelines en de getrainde gewichten |

| 6 | Prijstransparantie | 8% | Of alle kosten vooraf worden onthuld, inclusief onderhoud, infrastructuur en hertraining |

| 7 | Culturele Fit & Communicatie | 7% | Of de partner communiceert in bedrijfsresultaten, niet alleen technisch jargon |

| 8 | Langetermijnondersteuningsmodel | 5% | Of de partner gestructureerde post-implementatie ondersteuning biedt, niet alleen overdracht |

| Totaal | 100% |

Criterium 1: Domeinexpertise (25%)

Domeinexpertise is de belangrijkste onderscheidende factor omdat het bepaalt of de partner uw bedrijfsprobleem kan vertalen naar een technische oplossing die daadwerkelijk werkt in uw operationele context. Een partner met generieke AI-vaardigheden maar geen ervaring in uw sector zal weken besteden aan het begrijpen van uw datastructuren, sectorterminologie, regelgevende eisen en operationele beperkingen — alles wat een ervaren partner al weet.

Domeinexpertise manifesteert zich op drie verifieerbare manieren: de partner kan de typische data-architectuur in uw sector beschrijven zonder dat dit verteld hoeft te worden, de partner begrijpt sectorspecifieke regelgeving en hoe deze het AI-ontwerp beperkt (bijv. EU AI Act hoog-risicoclassificaties voor financiële dienstverlening en gezondheidszorg), en de partner kan verwijzen naar specifieke metrieken die ertoe doen in uw sector (niet generieke KPI’s, maar sectorspecifieke uitkomsten zoals voorspellingsnauwkeurigheid voor logistiek, OEE voor productie, of claimverwerkingstijd voor verzekeringen).

Hoe te verifiëren: Vraag de partner om de drie meest voorkomende data-uitdagingen in uw sector te beschrijven. Een ervaren partner noemt ze onmiddellijk. Vraag om twee casestudy’s in uw sector met gekwantificeerde resultaten. Generiek “we hebben een bedrijf geholpen de efficiëntie te verbeteren” is onvoldoende — eis specifieke metrieken, tijdlijnen en het bedrijfsprobleem dat werd opgelost.

Criterium 2: Methodologievolwassenheid (20%)

Een volwassen methodologie is het structurele verschil tussen een project dat op tijd en binnen budget wordt opgeleverd, en een project dat afdrijft naar eindeloze iteratie. De methodologie moet gedocumenteerd, herhaalbaar en fasepoort-gestuurd zijn — wat betekent dat elke fase gedefinieerde deliverables, succescriteria en een beslispoort heeft voordat naar de volgende fase wordt overgegaan.

Zoals besproken in Sectie 5 van deze reeks, omvat een uitgebreide AI-implementatiemethodologie afzonderlijke fasen voor probleemdefinitiie, databeoordeling, modelontwikkeling, integratie, validatie, implementatie en post-implementatie optimalisatie. Elke fase moet een gedocumenteerde tijdlijn, gedefinieerde deliverables en duidelijke go/no-go-criteria hebben. De afwezigheid van beslispoorten is de primaire structurele oorzaak van scope creep en budgetoverschrijdingen in AI-projecten. Effectieve leveranciersselectiekaders adviseren om het implementatie-trackrecord op 20% van de totale evaluatie te wegen.

Hoe te verifiëren: Vraag de methodologiedocumentatie van de partner op. Een volwassen partner levert een fase-voor-fase overzicht met deliverables en tijdlijnen zonder aarzeling. Vraag wat er gebeurt als de Fase 2 data-audit onthult dat de datakwaliteit onvoldoende is. Het antwoord moet een gestructureerd remediatieplan met kosten- en tijdlijnimpact bevatten — niet “dat lossen we dan wel op.”

Criterium 3: Data Engineering-Capaciteit (15%)

De meest ondergewaardeerde capaciteit in AI-partnerevaluatie is data engineering. 70% van de AI-projectfalen vindt zijn oorsprong in datagereedheidsproblemen, toch focussen de meeste evaluatieprocessen vrijwel uitsluitend op modelontwikkeling (het algoritme) in plaats van data engineering (de pipeline die het algoritme voedt). Een partner met uitstekende modelontwikkelingsvaardigheden maar zwakke data engineering-capaciteit zal een indrukwekkend model bouwen dat faalt in productie omdat de datapipeline fragiel, traag of onnauwkeurig is.

Data engineering-capaciteit omvat: ETL-pipelineontwerp en -automatisering (data extraheren uit meerdere bronsystemen, transformeren naar modelklaar formaat, en laden in de trainings- en inferentie-omgevingen), datakwaliteitsmonitoring (geautomatiseerde detectie van ontbrekende waarden, formaatwijzigingen en distributieverschuivingen), feature engineering (ruwe data transformeren naar de afgeleide variabelen waarvan modellen daadwerkelijk leren), en dataversiebeheer (bijhouden welke data is gebruikt om welke modelversie te trainen, essentieel voor debugging en compliance).

Hoe te verifiëren: Vraag de partner om hun aanpak te beschrijven voor een scenario waarin uw ERP data exporteert in drie verschillende formaten over twee legacy-systemen. Een sterke partner beschrijft hun ETL-aanpak, datakwaliteitspoorten en hoe ze schemawijzigingen verwerken. Een zwakke partner focust op het model en behandelt datavoorbereiding als een ondergeschikte voorbereidende stap.

Criterium 4: Productie-implementatie Track Record (10%)

88% van de AI-pilots bereikt nooit de productie. Dit statistiek betekent dat de meerderheid van AI-leveranciers ervaring heeft met het bouwen van pilots maar niet met het implementeren van productiesystemen. De kloof tussen een werkende pilot en een productiesysteem is enorm: productie vereist monitoringinfrastructuur, foutafhandeling, prestatieoptimalisatie onder reële belasting, beveiligingsverharding, gebruikerstoegangsbeheer en integratie met live bedrijfsworkflows. Een partner wiens portfolio voornamelijk bestaat uit proof-of-conceptprojecten mist mogelijk de operationele engineering-vaardigheden om deze kloof te overbruggen.

Hoe te verifiëren: Vraag hoeveel van hun afgeronde projecten momenteel in productie draaien. Vraag naar het langstdraaiende productiesysteem en de huidige prestatiemetrieken ervan. Vraag hoe hun monitoring- en waarschuwingsinfrastructuur eruitziet voor geïmplementeerde modellen. Een partner met echte productie-ervaring beschrijft driftdetectie, geautomatiseerde hertrainingstriggers en SLA-monitoring. Een partner met alleen pilotervaring beschrijft nauwkeurigheidsmetrieken uit de trainingsfase.

Criterium 5: IP-Eigendom en Datarechten (10%)

Dit is het criterium dat het meest waarschijnlijk langetermijn strategische schade veroorzaakt als het slecht wordt afgehandeld. Onderzoek van Stanford Law School op basis van TermScout-data toonde aan dat 92% van de AI-leverancierscontracten brede datagebruiksrechten claimen, ver boven het marktgemiddelde van 63%. Dit betekent dat de meerderheid van AI-leveranciers standaard rechten claimen om uw data te gebruiken voor doelen buiten uw project — mogelijk inclusief het trainen van modellen voor uw concurrenten.

De IP-eigendomsdiscussie moet vier afzonderlijke activa dekken: uw inputdata (moeten 100% van u blijven, zonder leverancierstrainingsrechten), de datapipeline (de ETL-logica, feature engineering-code en automatisering — moet aan u worden overgedragen), het getrainde model (de modelgewichten resulterend uit training op uw data — moeten van u zijn), en het onderliggende framework (de reeds bestaande codebibliotheken en tools van de partner — doorgaans gelicentieerd, niet overgedragen, wat redelijk is). Een partner die deze vier categorieën vermengt of die weerstand biedt tegen het specificeren van eigendom voor elke categorie is een significant risico.

Hoe te verifiëren: Een betrouwbare leverancier zou moeten instemmen met de meeste kern-IP-bepalingen. Vraag de standaard IP-clausule van de partner op vóór de offertefase. Als het contract de partner rechten verleent om uw data te gebruiken voor “serviceverbetering,” “productontwikkeling” of “modeltraining,” onderhandel expliciet over een “geen training, geen vermenging, geen bewaring”-clausule. Weigering om dit te doen is op zichzelf belangrijke informatie over hoe zij het partnerschap bezien.

Criterium 6: Prijstransparantie (8%)

Zoals gedetailleerd in Sectie 7 van deze reeks, kunnen de verborgen kosten in AI-projecten — dataremediatie, infrastructuur, scope-uitbreiding, modeldrift en onderhoud — de zichtbare ontwikkelingskosten overschrijden. Prijstransparantie betekent dat het voorstel alle kostencomponenten omvat: ontwikkeling, datavoorbereiding, infrastructuur, integratie, verandermanagement, testen en post-implementatie onderhoud. Het betekent ook dat het prijsmodel duidelijk is gestructureerd — of het nu vaste prijs, time-and-materials of mijlpaalgebaseerd is — met gedefinieerde scopegrenzen voor elk.

Hoe te verifiëren: Pas de Kostentransparantie-Checklist uit Sectie 7 toe: bevat het voorstel totale projectkosten, schattingen voor datavoorbereiding, infrastructuurkosten, integratiekosten, verandermanagementbudget, onderhoudskosten, hertrainingsfrequentie en -kosten, en een duidelijke IP-eigendomsclausule? Elk ontbrekend punt moet worden opgevraagd vóór evaluatie. De bereidheid van de partner om volledige transparantie te bieden is op zichzelf een evaluatiedatapunt.

Criterium 7: Culturele Fit en Communicatie (7%)

AI-projecten vereisen intensieve samenwerking tussen het technische team van de partner en de bedrijfsstakeholders van de klant. Als de partner primair communiceert in technisch jargon (precision, recall, F1-scores, gradient descent) zonder deze concepten te vertalen naar bedrijfsimpact (wat betekent 93% nauwkeurigheid voor onze operaties?), zal de samenwerking afbrokkelen en het stakeholdervertrouwen eroderen. Culturele en strategische fit weegt mogelijk slechts 5–7% in formele evaluatiekaders, maar niet-afgestemde leveranciersrelaties veroorzaken een onevenredig aandeel van enterprise-contractbeëindigingen. De partner moet het vermogen tonen om technisch werk te presenteren aan niet-technische stakeholders, op bedrijfsvragen te antwoorden met bedrijfsantwoorden, en communicatiefrequentie en -formaat aan te passen aan de voorkeuren van de klant.

Hoe te verifiëren: Vraag de partner in het evaluatiegesprek om het resultaat van een recent project uit te leggen aan een niet-technisch publiek. Als ze standaard terugvallen op technische metrieken zonder deze te verbinden met bedrijfsresultaten, zal de communicatiekloof het gehele project voortduren. Beoordeel ook de responsiviteit tijdens het verkoopproces — als ze traag reageren voordat ze uw geld hebben, zullen ze daarna niet verbeteren.

Criterium 8: Langetermijnondersteuningsmodel (5%)

AI-systemen vereisen doorlopend onderhoud, monitoring en optimalisatie (Sectie 7: de 100/25/25-regel). Het ondersteuningsmodel van de partner bepaalt of uw AI-systeem in de loop van de tijd verbetert of degradeert. Een partner wiens engagementmodel “bouwen en overdragen” is, laat u achter met een systeem dat binnen 12–18 maanden zal degraderen naarmate datapatronen verschuiven en modelnauwkeurigheid afneemt.

Een sterk ondersteuningsmodel omvat gedefinieerde SLA’s voor responstijd en probleemoplossing, geplande modelprestatiereviews (kwartaal- of halfjaarlijks), proactieve driftdetectie en hertrainingsaanbevelingen, een duidelijk escalatiepad voor prestatiedegradatie, en transparante onderhoudsprijzen die vóór de projectstart worden overeengekomen. Het ondersteuningsmodel moet worden besproken en overeengekomen tijdens de evaluatiefase, niet als bijgedachte na implementatie.

Hoe te verifiëren: Vraag wat het standaard post-implementatie ondersteuningspakket van de partner omvat, hoe lang het duurt en wat het kost. Vraag wat er gebeurt wanneer modelnauwkeurigheid onder de afgesproken drempel zakt. Een sterke partner beschrijft hun monitoringinfrastructuur, hertrainingsproces en SLA-voorwaarden. Een zwakke partner beschrijft “ad hoc ondersteuning indien nodig.”

De Negen Rode Vlaggen Die Falen Voorspellen

Deze waarschuwingssignalen, waargenomen tijdens de evaluatie- en offertefase, correleren sterk met projectfalen. Elke enkele rode vlag rechtvaardigt voorzichtigheid. Drie of meer rechtvaardigen diskwalificatie.

1. Demogedreven verkoop zonder business case-discussie. Als het evaluatiegesprek van de partner draait om het demonstreren van hun technologie (indrukwekkende dashboards, real-time visualisaties, modelnauwkeurigheidsgrafieken) zonder eerst uw bedrijfsprobleem, omzetimpact en succescriteria te begrijpen, verkopen ze technologie in plaats van problemen op te lossen.

2. Vage of ontbrekende methodologiedocumentatie. Een partner die geen geschreven methodologie kan leveren met gedefinieerde fasen, deliverables en beslispoorten heeft ofwel geen methodologie (hoog risico) of heeft een methodologie die ze niet willen delen (vertrouwenskwestie).

3. Weerstand tegen IP-eigendomsdiscussie. 92% van de AI-leverancierscontracten claimt brede datagebruiksrechten. Als de partner het IP-eigendomsgesprek afwimpelt of uitstelt (“dat regelen we in de contractfase”), hebben ze waarschijnlijk standaardvoorwaarden die de leverancier bevoordelen.

4. Geen productiereferenties. Een partner wiens referenties allemaal pilot- of proof-of-conceptprojecten zijn, heeft niet aangetoond in staat te zijn AI te implementeren en te onderhouden in een live bedrijfsomgeving.

5. Eén-technologiebenadering. Een partner die dezelfde technologie-stack aanbeveelt voor elke klant en elk probleem past uw probleem in hun oplossing in plaats van een oplossing te ontwerpen voor uw probleem.

6. Onrealistische tijdlijnbeloften. Als een partner een volledig geïmplementeerd, productierijp AI-systeem belooft in vier weken voor een multi-systeemintegratieproject, is de tijdlijn niet ambitieus — het is onrealistisch.

7. Geen data-assessmentfase. 43% van de bedrijven noemt datakwaliteit als hun grootste AI-obstakel. Een partner die voorstelt onmiddellijk met modelontwikkeling te beginnen, zonder een specifieke data-assessmentfase, slaat de stap over die bepaalt of het project kan slagen.

8. Prijsstelling zonder onderhoud. Een voorstel dat alleen ontwikkelingskosten noemt zonder Jaar 2+-onderhoud te adresseren is ofwel naïef of opzettelijk onvolledig. Ontwikkeling is 40–50% van de driejaars totale eigendomskosten.

9. Onvermogen om falen uit te leggen. Elke ervaren AI-partner heeft projecten gehad die niet volgens plan verliepen. Als een partner een slagingspercentage van 100% claimt of geen project kan beschrijven dat significante uitdagingen ondervond, zijn ze ofwel te onervaren om falen te hebben meegemaakt of te oneerlijk om het te erkennen. Beide zijn diskwalificerend.

De Twintig Vragen om te Stellen Voordat U Tekent

Deze vragen zijn ontworpen om de werkelijke capaciteiten en werkpraktijken van de partner te onthullen, niet hun marketingclaims. Stel ze in het evaluatiegesprek en beoordeel de specificiteit en het vertrouwen van de antwoorden.

Strategie en Aanpak

1. Hoe zou u het bedrijfsprobleem definiëren dat we proberen op te lossen, en welke metriek zou u gebruiken om succes te meten?

2. Wat is uw methodologie om te bepalen of maatwerk AI de juiste benadering is voor dit probleem, vs. standaardsoftware of fine-tuning?

3. Beschrijf een project waarin u de klant adviseerde niet door te gaan met AI. Wat was de redenering?

Data en Technisch

4. Hoe ziet uw data-assessmentfase eruit, en wat gebeurt er als de datakwaliteit onder uw drempel ligt?

5. Hoe gaat u om met integratie met legacy-systemen die geen moderne API’s hebben?

6. Wat is uw aanpak voor modelvalidatie en biastesten?

7. Hoe monitort u modelprestaties in productie, en wat triggert een hertrainingscyclus?

Oplevering en Track Record

8. Hoeveel van uw afgeronde projecten draaien momenteel in productie, en hoe lang al?

9. Kunt u een referentie verstrekken van een klant in onze sector met een vergelijkbare use case?

10. Beschrijf een project dat niet volgens plan verliep. Wat ging er mis en wat heeft u geleerd?

11. Wat is uw gemiddelde tijdlijn van projectstart tot productie-implementatie?

Commercieel en Juridisch

12. Wie is eigenaar van het getrainde model, de datapipeline en de modelgewichten na afronding van het project?

13. Bevat uw standaardcontract rechten om onze data te gebruiken voor doelen buiten dit project?

14. Wat is inbegrepen in de voorgestelde kosten, en welke kosten zijn uitgesloten (infrastructuur, hertraining, onderhoud)?

15. Wat is uw prijsmodel: vaste prijs, time-and-materials of mijlpaalgebaseerd?

Ondersteuning en Continuïteit

16. Wat omvat uw post-implementatie ondersteuningsmodel, en wat kost het?

17. Wat gebeurt er als de nauwkeurigheid van het model onder de afgesproken drempel zakt in productie?

18. Hoe gaat u om met kennisoverdracht aan ons interne team?

19. Wat is uw aanpak voor EU AI Act-compliance voor systemen die als hoog-risico kunnen worden geclassificeerd?

20. Als we besluiten na implementatie van partner te wisselen, wat behouden we en wat is het transitieproces?

Een sterke partner beantwoordt alle twintig vragen met specificiteit en vertrouwen. Ontwijking, afleiding of generieke antwoorden op een van deze vragen moeten als negatief signaal worden gewogen in de evaluatie.

Uw RFP Structureren voor Vergelijkbare Reacties

Een ongestructureerd RFP produceert onvergelijkbare reacties. Een gestructureerd RFP dwingt leveranciers dezelfde criteria in hetzelfde formaat te adresseren, waardoor gewogen scoring mogelijk wordt die de beste partner onthult — niet alleen de beste schrijver.

Uw AI-project RFP moet deze zeven secties bevatten, elk met specifieke instructies voor de respondent:

Sectie 1: Bedrijf en Team. Bedrijfsachtergrond, teamsamenstelling voor dit project (benoemde personen en hun relevante ervaring), en drie vergelijkbare projectreferenties met klantcontactinformatie.

Sectie 2: Probleembegrip. Het begrip van de respondent van uw bedrijfsprobleem, voorgestelde succesmetriek, en voorlopige haalbaarheidsanalyse op basis van de verstrekte informatie.

Sectie 3: Methodologie en Tijdlijn. Fase-voor-fase aanpak met deliverables, tijdlijnen, beslispoorten en middelenallocatie per fase. Expliciete vermelding van wat een scope- of tijdlijnwijziging triggert.

Sectie 4: Technische Aanpak. Voorgestelde technologie-stack, modelarchitectuur, data engineering-aanpak, integratieplan en test-/validatiemethodologie. Onderbouwing van technologiekeuzes.

Sectie 5: Commerciële Voorwaarden. Totale projectkosten uitgesplitst per fase, jaarlijkse onderhoudskostenschatting, infrastructuurkostenschatting, hertrainingskosten en -frequentie, en prijsmodel (vast/T&M/mijlpaal).

Sectie 6: IP en Datarechten. Expliciete verklaring van IP-eigendom per activacategorie: klantdata, datapipeline, getraind model en reeds bestaand framework van de partner. Datagebruiksbeperkingen en verwijderingsvoorwaarden.

Sectie 7: Post-implementatie Ondersteuning. Beschrijving van ondersteuningsmodel, SLA-voorwaarden, monitoring- en onderhoudsbenadering, kennisoverdrachtplan en transitie-/exitbepalingen.

Scoor elke sectie met behulp van de gewogen criteria uit het evaluatiekader. Vereis dat alle respondenten hun voorstel presenteren aan dezelfde stakeholdergroep, en neem een live Q&A-sessie op waarin de twintig evaluatievragen kunnen worden gesteld. Het vermogen van de partner om onvoorbereide vragen te beantwoorden is vaak onthullender dan het geschreven voorstel.

Benelux-Specifieke Overwegingen

Het kiezen van een AI-partner in de Benelux-regio introduceert specifieke overwegingen rond taal, regelgeving en marktcontext die de evaluatie en het projectsucces beïnvloeden.

Regelgevingsbekendheid. Nederland en België bevinden zich op het kruispunt van meerdere regelgevingskaders: de EU AI Act, AVG/GDPR, sectorspecifieke regelgeving (DNB/AFM voor financiële dienstverlening, IGJ voor gezondheidszorg), en Nederlandse belastingvoordelen voor R&D-innovatie. Een partner die opereert in de Benelux moet vertrouwdheid tonen met deze kaders en hoe ze AI-ontwerpkeuzes beïnvloeden — met name het onderscheid van de EU AI Act tussen beperkt-risico en hoog-risico AI-systemen, dat de documentatie-, transparantie- en menselijk toezicht-eisen bepaalt.

Meertalige capaciteit. Benelux-activiteiten omvatten regelmatig Nederlands, Frans, Duits en Engels — soms binnen een enkel bedrijfsproces. Maatwerk AI-oplossingen die tekst verwerken (klantcommunicatie, documenten, productbeschrijvingen) vereisen NLP-modellen die meertalige input nauwkeurig verwerken. Een partner moet ervaring tonen met meertalige NLP, inclusief de regionale taalvariaties tussen Nederlands-Nederlands en Belgisch-Nederlands, en tussen Frans en Belgisch-Frans.

MKB-gerichte aanpak. De Benelux-middenmarkt wordt gekenmerkt door bedrijven met € 2–50M omzet, 20–500 medewerkers en pragmatische besluitvormingsculturen. Deze bedrijven hebben partners nodig die kunnen werken binnen realistische budgetten (€25K–€ 150K, niet €500K+), tastbare resultaten leveren binnen 12–20 weken (niet 12–18 maanden), en communiceren in bedrijfsresultaten in plaats van academische onderzoekstermen. Een AI-partner wiens typische engagement enterprise-schaal is (€ 500K+, 12+ maanden) is mogelijk niet gekalibreerd voor Benelux-middenmarkt uitvoeringssnelheid en budgetverwachtingen.

Nabijheid en bereikbaarheid.Voor bedrijven waar het AI-systeem kernactiviteiten raakt, voegt het vermogen om face-to-face vergaderingen te hebben tijdens kritieke projectfasen (kickoff, data-auditresultaten, implementatiegereedheidsreview) significante waarde toe. Een partner gevestigd in de Benelux of met een lokale aanwezigheid biedt snellere communicatiecycli en elimineert tijdzonegerelateerde vertragingen tijdens kritieke fasen.

Veelgestelde Vragen

Welke vragen moet ik stellen aan een AI-leverancier?

Focus op twintig vragen in vier gebieden: strategie en aanpak (hoe ze het probleem definiëren en succes meten), data en technisch (data-assessment, integratie, monitoringaanpak), opleverings-trackrecord (productiereferenties, tijdlijnrealisme, falenvoorbeelden), en commercieel/juridisch (IP-eigendom, totale kosten, ondersteuningsmodel). De specificiteit en het vertrouwen waarmee de partner antwoordt onthult meer dan hun marketingmateriaal.

Hoe evalueer ik AI-adviesbureaus?

Gebruik een gewogen scorekader met acht criteria: domeinexpertise (25%), methodologievolwassenheid (20%), data engineering (15%), productie-trackrecord (10%), IP-eigendom (10%), prijstransparantie (8%), culturele fit (7%) en langetermijnondersteuning (5%). Scoor elke partner 1–5 op basis van verifieerbaar bewijs, vermenigvuldig met het gewicht en vergelijk totalen. Vul aan met referentiechecks bij klanten in uw sector.

Wat is het grootste risico bij het kiezen van een AI-partner?

Het grootste risico is een partner selecteren op basis van demo-indrukken of prijs in plaats van methodologie en trackrecord. 74% van de bedrijven worstelt om AI-waarde te extraheren, en veel mislukkingen zijn te herleiden naar partnerselectie op basis van presentatiekwaliteit in plaats van implementatiecapaciteit.

Moet ik een groot adviesbureau kiezen of een gespecialiseerde AI-partner?

Gespecialiseerde AI-partners bieden doorgaans diepere technische expertise, snellere oplevering, competitievere prijsstelling en directere toegang tot senior specialisten. Grote adviesbureaus bieden bredere serviceportfolio’s en merknaamsgeruststelling maar leveren vaak via junior teams tegen premiumtarieven. Voor middelgrote bedrijven met budgetten van €25K–€200K is een gespecialiseerde partner doorgaans de betere keuze.

Hoe belangrijk is IP-eigendom in AI-projecten?

Cruciaal. 92% van de AI-leveranciers claimt standaard brede datagebruiksrechten. Als u niet expliciet onderhandelt over eigendom van uw datapipeline, getraind model en modelgewichten, kan het zijn dat uw concurrentievoordeel niet exclusief van u is. De IP-discussie moet plaatsvinden vóór het voorstel, niet in de kleine lettertjes van het contract.

Hoe lang moet leveranciersevaluatie duren?

Voor een middelgroot AI-project (€25K–€150K) moet evaluatie 2–4 weken duren: 1 week voor RFP-verspreiding en -reactie, 1–2 weken voor evaluatiegesprekken en referentiechecks, en 1 week voor scoring en beslissing. Langere evaluatie verbetert de besliskwaliteit niet — het vertraagt de time-to-value.

Wat als geen partner hoog scoort op alle criteria?

Perfectie is niet de standaard — op bewijs gebaseerd vertrouwen wel. Focus op het gewogen totaal: een partner die 4+ scoort op domeinexpertise en methodologievolwassenheid met 3 op ondersteuning is een sterkere keuze dan een partner die 3 scoort op alle criteria. Prioriteer de criteria die succes voorspellen (domeinexpertise en methodologie), en onderhandel over verbeteringen op lager scorende gebieden tijdens de contractfase.

Kernpunten

— Leveranciersgeleide implementaties slagen 2× zo vaak als interne builds (67% vs. 33%) — partnerselectie is de beslissing met de hoogste hefboomwerking in uw AI-investering.

— Gebruik de acht gewogen criteria: domeinexpertise (25%), methodologievolwassenheid (20%), data engineering (15%), productie-trackrecord (10%), IP-eigendom (10%), prijstransparantie (8%), culturele fit (7%) en langetermijnondersteuning (5%).

— Let op negen rode vlaggen: demogedreven verkoop, vage methodologie, IP-weerstand, geen productiereferenties, één-technologiebenadering, onrealistische tijdlijnen, geen data-assessmentfase, onderhoudsvrije prijsstelling, en onvermogen om falen te bespreken.

— 92% van de AI-leverancierscontracten claimt brede datagebruiksrechten — onderhandel IP-eigendom expliciet voordat u tekent.

— Structureer uw RFP in zeven secties voor vergelijkbare reacties, en scoor met behulp van de gewogen evaluatiescorekaard.

— Prioriteer in de Benelux-middenmarkt partners met regelgevingsbekendheid, meertalige capaciteit, MKB-gerichte opleveringssnelheid en lokale bereikbaarheid.

Bronnen

1. MIT Project NANDA — The GenAI Divide: State of AI in Business 2025. fortune.com

2. BCG — AI Adoption in 2024: 74% of Companies Struggle. bcg.com

3. Stanford Law School / TermScout — Navigating AI Vendor Contracts, maart 2025. law.stanford.edu

4. RTS Labs — Enterprise AI Roadmap: 70% of Failures from Data Issues. rtslabs.com

5. WorkOS — Why Most Enterprise AI Projects Fail. workos.com

6. Arphie — Mastering the Vendor Selection Process 2025. arphie.ai

7. BrianOnAI — Third-Party AI Contract Addendum Template. brianonai.com

8. Netguru — How to Evaluate AI Vendors: A Step-by-Step Guide. netguru.com

9. CTO Magazine — The Great AI Vendor Lock-In. ctomagazine.com

10. Europese Commissie — EU AI Act Regelgevingskader. digital-strategy.ec.europa.eu